« En ce moment, ils ne sont pas plus intelligents que nous, pour autant que je sache. Mais je pense qu’ils le seront bientôt. »

Un homme souvent qualifié de « parrain » de l’intelligence artificielle (IA) a quitté son emploi chez Google cette semaine en raison d’inquiétudes quant à la direction que prend l’IA.

Geoffrey Hinton est surtout connu pour ses travaux sur l’apprentissage en profondeur et les réseaux de neurones, pour lesquels il a remporté le prix Turing d’un million de dollars en 2019. À l’époque, il a déclaré à CBC qu’il était heureux d’avoir gagné parce que « pendant longtemps, les réseaux de neurones étaient considéré comme instables en informatique.

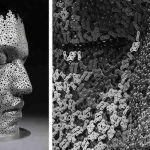

Depuis lors, avec la montée en puissance de programmes d’IA tels que Chat-GPT et les générateurs d’images AI parmi tant d’autres , la méthode s’est généralisée.

Hinton, qui a commencé à travailler chez Google en 2013 après l’acquisition de son entreprise par le géant de la technologie, estime désormais que la technologie pourrait présenter des dangers pour la société et a quitté l’entreprise afin de pouvoir en parler ouvertement, rapporte le New York Times .

À court terme, Hinton s’inquiète de la possibilité que des textes, des images et des vidéos générés par l’IA empêchent les gens de ne plus « savoir plus ce qui est vrai », ainsi que d’une perturbation potentielle du marché du travail. À plus long terme, il est beaucoup plus préoccupé par le fait que l’IA éclipse l’intelligence humaine et que l’IA apprenne des comportements inattendus .

« En ce moment, ils ne sont pas plus intelligents que nous, pour autant que je sache », a-t-il déclaré à la BBC . « Mais je pense qu’ils le seront bientôt. »

Hinton, 75 ans, a déclaré à la BBC que l’IA est actuellement en retard sur les humains en termes de raisonnement, bien qu’elle fasse déjà un raisonnement « simple ». En termes de connaissances générales, cependant, il estime qu’elle est déjà loin devant les humains.

« Toutes ces copies peuvent apprendre séparément mais partager leurs connaissances instantanément », a-t-il déclaré à la BBC. « Donc, c’est comme si vous aviez 10 000 personnes et chaque fois qu’une personne apprenait quelque chose, tout le monde le savait automatiquement. »

Une préoccupation, a-t-il déclaré au New York Times, est que les « mauvais acteurs » pourraient utiliser l’IA à leurs propres fins néfastes.

Contrairement aux menaces telles que les armes nucléaires, qui nécessitent des infrastructures et des substances surveillées comme l’uranium, la recherche sur l’IA par de tels acteurs serait beaucoup plus difficile à surveiller.

« C’est juste une sorte de pire scénario, une sorte de scénario cauchemardesque », a-t-il déclaré à la BBC. « Vous pouvez imaginer, par exemple, qu’un mauvais acteur comme Poutine a décidé de donner aux robots la possibilité de créer leurs propres sous-objectifs. »

Des sous-objectifs tels que « J’ai besoin de plus de pouvoir » pourraient entraîner des problèmes que nous n’avons pas encore imaginés, sans parler de la façon de les gérer.

Comme l’a expliqué en 2014 Nick Bostrom, philosophe spécialisé dans l’IA et directeur du Future of Humanity Institute de l’Université d’Oxford, même une simple instruction visant à maximiser le nombre de trombones dans le monde pourrait entraîner des sous-objectifs imprévus qui pourraient avoir des conséquences terribles pour l’IA.

« L’IA se rendra compte rapidement que ce serait bien mieux s’il n’y avait pas d’humains parce que les humains pourraient décider de l’éteindre », a-t-il expliqué au HuffPost en 2014.

« Parce que si les humains le faisaient, il y aurait moins de trombones. Aussi, les corps humains contiennent beaucoup d’atomes qui pourraient être transformés en trombones. L’avenir vers lequel l’IA essaierait de se diriger serait celui dans lequel il y aurait beaucoup de trombones mais pas d’humains.

Hinton, qui a déclaré à la BBC que son âge avait joué un rôle dans sa décision de prendre sa retraite, estime que les avantages potentiels de l’IA sont énormes, mais la technologie doit être réglementée, en particulier compte tenu du rythme actuel des progrès dans le domaine.

Bien qu’il soit parti pour parler des pièges potentiels de l’IA, il estime que Google a jusqu’à présent agi de manière responsable sur le terrain. Avec une course mondiale pour développer la technologie, il est probable que – si elle n’est pas réglementée – tout le monde ne le sera pas, et l’humanité devra faire face aux conséquences.